Машинная этика

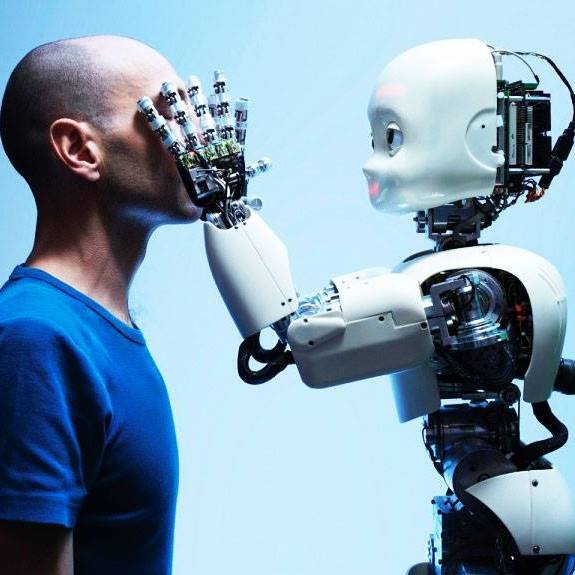

Машинная этика (или машинная мораль) – область исследований, связанная с разработкой искусственных существ, способных отвечать за свои действия – роботов или компьютеров с искусственным интеллектом, который ведет себя высокоморально, как носитель этического учения.

Айзек Азимов рассматривал вопрос в 1950-х годах в своем сборнике рассказов «Я, Робот». По настоянию своего редактора Джона Кэмпбелла-младшего он предложил Три закона робототехника для управления системами с ИИ. Большая часть его работ проверяла ограничения трех законов робототехники, чтобы увидеть, что случится, если они перестанут работать, или те случаи, когда они приводят к парадоксальному или неожиданному поведению. Его произведение предполагает, что не существует установленных правил, способных предвидеть все возможные обстоятельства.

В 2009 году при эксперименте в Лаборатории Интеллектуальных Систем при Политехнической Высшей Школе в Лозанне (Швейцария) роботы, запрограммированные на сотрудничество друг с другом (для поиска полезных ресурсов и избегания ядовитых), в итоге, научились врать друг другу для того, чтобы накопить полезные ресурсы. Проблемой в этом случае может стать то, что цели были «ограничены в сроках» (т.е., в отличие от них, предельные человеческие мотивы, как правило, имеют качество требуемого постоянного обучения).

Некоторые эксперты и академики ставили под вопрос использование роботов в качестве боевых средств, особенно когда такие роботы имеют некоторую степень автономности. ВМФ США профинансировал исследование, показавшее, что боевые роботы оказались гораздо сложнее, поэтому должно быть уделено больше внимания использованию их способности к принятию самостоятельных решений. Президент Американской ассоциации по искусственному интеллекту приказал начать исследования для изучения этого вопроса. Они указывают на программы типа Механизма овладения языком, способного подражать человеческому взаимодействию.

Вернор Виндж предполагал, что может прийти момент, когда некоторые компьютеры станут умнее человека. Он называет это явление «Сингулярностью». Он предполагают, что это может стать в некоторой степени или, вероятно, очень опасным для человечества. Этот вопрос обсуждается в рамках философского течения, называемого Сингулярианством. Научно-исследовательский институт машинного интеллекта предполагает потребность в создании «Дружественного ИИ», что означает, что прогресс, уже произошедший в области ИИ, должен также включать усилия по созданию от природы дружелюбного и человечного ИИ.

В 2009 году академики и технические эксперты посетили конференцию, организованную Ассоциацией по развитию искусственного интеллекта, для обсуждения возможного влияния роботов и компьютеров и последствия гипотетической возможности того, что они могут стать самостоятельными и способными принимать свои решения. Они обсудили возможность и степень того, насколько компьютеры и роботу могут стать способными к получению любой степени автономии, и до какой степени они смогут использовать такие способности для демонстрации какой-либо угрозы или опасности. Они отметили, что некоторые машины получили различные формы частичной автономии, в том числе – способность находить источники энергии по своему усмотрению и независимо выбирать цели для вооруженной атаки. Также они отметили, что некоторые компьютерные вирусы могут избежать уничтожения и получить «тараканий интеллект». Они отметили, что самосознание, описанное в научной фантастики, маловероятно, но существуют другие возможные опасности и трудности.

Однако есть и те технологии, которые, в частности, могут действительно сделать роботов с моральной компетенцией реальностью. В статье о приобретении роботами моральных ценностей, Найеф Аль-Родхан упоминает нейроморфные чипы, которые предназначены для обработки информации по принципу, схожему с человеческим, нелинейно и с миллионами взаимосвязанных искусственных нейронов. Роботы со встроенной нейроморфной технологией могут обучаться и получать знания исключительно по человеческой модели. Рано или поздно это поднимет вопрос условий, в которых такие роботы смогут узнавать мир, и чью мораль они будут унаследовать или когда они закончат изучать «слабости» человека: эгоизм, эгоистичную позицию, нерешительность и так далее.

В книге «Машины морали: Обучение роботов тому, что такое хорошо и что такое плохо» Уендэлл Уоллич и Колин Ален делают вывод, что попытки научить роботов тому, что такое хорошо и что такое плохо, вероятнее всего, приведут к улучшению понимания человеческой этики за счет мотивации людей к обращению к разрыву в современной нормативной теории и обеспечения платформы для экспериментальных исследований. В качестве примера, они привели нормативных этиков и их отношение к противоречивому вопросу о том, какие конкретные обучающие алгоритмы стоит использовать для машин. Ник Бостром и Элиезер Юдковский доказывали приоритет дерева решений (типа ID3) над нейронными сетями и генетическими алгоритмами по той причине, что дерево решений подчиняется современным социальным нормам честности и предсказуемости (к примеру, господствующая сила прецедента). Тогда как Крис Сантос-Лэнг настаивал на противоположном мнении, основываясь на том, что нормы любой эпохи должны быть изменяемыми, и что естественный отказ от полного исполнения этих особенных норм станет важным для меньшей уязвимости людей к преступным «хакерам».

Непредусмотренные последствия

Многие исследователи утверждали, что, через «интеллектуальный взрыв» примерно в XXI веке самосовершенствующийся ИИ может стать гораздо мощнее, чем человек, из-за чего мы не сможем остановить их в достижении их целей. В своем докладе «Этические вопросы развития искусственного интеллекта» философ Ник Бостром утверждает, что искусственный интеллект обладает способностями, которые могут привести к уничтожению человечества. Он заявляет, что всеобщий сверхинтеллект может быть способным к независимой инициативе и разработке собственных планов, и поэтому, может быть, соответственно, воспринимаемым как автономный агент. Хоть искусственному интеллекту не обязательно разделять человеческие мотивации, он может быть равным разработку сверхинтеллекта в определении собственных мотиваций. В теории, сверхинтеллект может стать причиной любого возможного исхода и получить способность прерывать все попытки предотвратить выполнение своей конечной цели, что может привести к многим неконтролируемым и непредусмотренным последствиям.

Однако вместо уничтожения человеческого рода и подведения к разрушению, Бостром утверждает, что сверхинтеллект может помочь нам решить многие сложные проблемы типа болезней, бедности и разрушения окружающей среды, и могут помочь нам «улучшить» себя.

Большая сложность системы человеческих ценностей делает ее сложной для создания ИИ с дружественной к человеку мотивацией. Хоть этическая философия дает нам совершенную этическую теорию, функции полезности ИИ могут реализовать многие потенциально опасные сценарии, которые соответствуют данной этической модели, но не «здравому смыслу». Согласно Элиезеру Юдковскому, существует незначительное основание полагать, что искусственно разработанный мозг может обладать такой способностью к адаптации.

Билл Хаббард предлагает концепцию ИИ, которая не использует несколько типов непредусмотренного поведения, в их числе – самообман, непредусмотренные рациональные действия и моральное разложение в отношениях с создателем.

Организации

«Amazon», «Google», «Facebook», «IBM» и «Microsoft» организовали некоммерческую компанию для создания наилучших практичных технологий с ИИ, улучшения понимания технологии общественностью, и служит в качестве платформы для ИИ. Они утверждают: «Эта компания по ИИ будет обеспечивать исследования, организовывать дискуссии, обеспечивать интеллектуальное лидерство, консультироваться с другими специализированными компаниями, отвечать на вопросы от общественности и СМИ, и создавать образовательные материал, которые улучшают понимание ИИ-технологий, в том числе – машинного восприятия, обучения и автоматизации формулирования логических выводов». В январе 2017 года среди других технологических компаний-членов Компании появилась «Apple». Члены компании будут делать вклады в финансирование и научные исследования группы, одновременно работая с научным сообществом во главе с академиками.

В художественных произведениях

Фильм «Тринадцатый этаж» предлагает будущее, где симулированные миры с наделенными сознанием обитателями созданы компьютерными игровыми консолями с целью развлечения. Фильм «Матрица» предлагает будущее, где преобладающими видами на планете Земля стали разумные машины, а человечество подверглось видовой дискриминации в наихудшем ее проявлении. Рассказ «Планковский прыжок» предлагает вариант будущего, где человечество превратилось в программы, которые можно дублировать и оптимизировать, и постепенно проявилось разделение между типами программ на разумных и неразумных. Та же идея может быть обнаружена на борту крейсера «Вояджер» в виде Голограммы Скорой Помощи, который, очевидно, является разумной копией уменьшенного фрагмента сознания своего создателя – Доктора Циммермана, который из самых лучших побуждений создал систему, оказывающую медицинскую помощь в экстренных случаях. В фильмах «Двухсотлетний человек» и «Искусственный разум» сюжет связан с возможностью разумных испытывать любовь. Фильм «Я, робот» исследует некоторые аспекты трех законов Азимова. Все эти сценарии пытаются предсказать возможные неэтичные последствия создания разумных компьютеров.

Этика искусственного интеллекта – одна из нескольких основных тем серии игр «Mass Effect» от «BioWare». Она исследует сценарий, где цивилизация случайно создала ИИ из-за быстрого роста вычислительных мощностей посредством глобальной нейронной сети. Это событие привело к этическому расколу между теми, кто осознавал, что необходимо передать органические права созданным разумным Гетам, и теми, кто продолжал считать их одноразовыми машинами и сражался с ними. Несмотря на изначальный конфликт, сложность отношений между машинами и их создателями – еще одна сквозная тема истории.

Спустя время, дебаты стали все меньше фокусироваться на возможности, а больше – на желательности, как подчеркивалось в дебатах между «Пришельцем» и «Землянином», инициированных Хьюго де Гаррисом и Кевином Уорвиком. Согласно словам Хьюго де Гаррисом, «Пришелец» уже сегодня пытается построить как можно больше разумных наследников человеческого рода.